¿Por qué la inteligencia artificial se equivoca siempre con el mismo patrón? Porque no se trata de un error técnico ni de una simple falla del sistema. La inteligencia artificial no imagina: aprende. Aprende de datos. Y los datos, lejos de ser neutros u objetivos, están construidos en contextos sociales atravesados por relaciones de poder. Cuando una IA confunde a una mujer con un varón, no está fallando: está mostrando desde dónde fue entrenada para mirar.

Me sumé al juego viral porque me pareció simpático. Copié el prompt y esperé la caricatura generada por inteligencia artificial sobre la base de lo que ella sabía de mí. Sorpresa: la imagen que devolvió la IA era la de un varón. Lamento no haber guardado la captura de pantalla. Pronto advertí que no se trataba de un caso aislado: en las redes sociales muchas mujeres contaban que les había pasado lo mismo.

La escena podía leerse en clave de anécdota (ingenuamente pensé que se había confundido por mi sobrenombre, que se utiliza tanto para varones como para mujeres) o de simple error técnico. Sin embargo, la reiteración nos obliga a otras preguntas: ¿por qué la inteligencia artificial se equivoca siempre para el mismo lado?

La IA no imagina ni interpreta: aprende. Aprende de datos. Y los datos no son neutrales ni objetivos. Están producidos en contextos sociales, históricos y políticos atravesados por desigualdades. Cuando una inteligencia artificial confunde a una mujer con un varón, no está fallando: está mostrando desde qué matrices fue entrenada para reconocer identidades.

Esta idea no es mía: es el eje del artículo “Tecnopolíticas feministas: resistencias digitales, justicia de datos y soberanía tecnológica en América Latina”, que escribieron Silvina Molina, Susana Morales y Leonor Natansohn.

En el ensayo, las autoras advierten que los sistemas de inteligencia artificial no solo reproducen desigualdades existentes, sino que pueden amplificarlas cuando se apoyan en datos sesgados, incompletos o construidos desde una falsa idea de universalidad.

La economía política de los datos resulta clave para entender este fenómeno. Las principales tecnologías de IA se entrenan con grandes volúmenes de información producidos mayoritariamente en el norte global, bajo parámetros que toman al varón blanco heterosexual como norma. Todo aquello que no se ajusta a ese estándar —mujeres, identidades disidentes, cuerpos racializados— aparece mal clasificado, invisibilizado o directamente excluido.

Las autoras citan el caso de Joy Buolamwini, científica ghanesa-estadounidense, que resulta muy ilustrativo. Al comprobar que los sistemas de reconocimiento facial con los que trabajaba no identificaban su rostro si no usaba una máscara blanca, demostró que no se trataba de una falla puntual, sino de un patrón estructural. A partir de esa experiencia impulsó la Algorithmic Justice League, orientada a visibilizar los impactos del racismo y el sexismo algorítmico en los derechos de las personas.

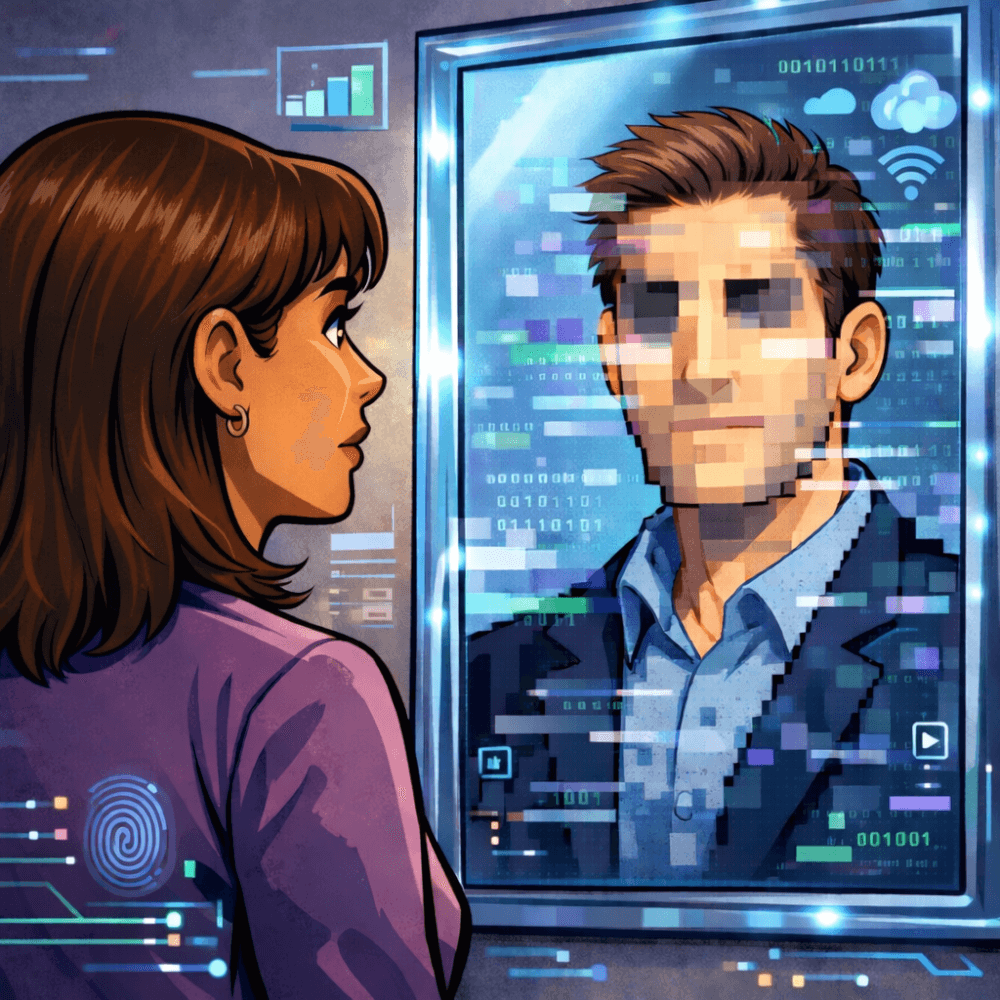

Lejos de quedarse en la denuncia, Molina, Morales y Natanson proponen una agenda de tecnopolíticas feministas que articula feminismo de datos, soberanía tecnológica y cuidados digitales. Una agenda que reclama participación activa de mujeres y disidencias en el diseño de las IA, control sobre el etiquetado de datos, cuestionamiento del binarismo sexo-genérico y desarrollo de tecnologías situadas, pensadas desde las realidades locales.

En América Latina, estas perspectivas ya se expresan en prácticas concretas de ciberfeminismo y hacker feminismo, que disputan la idea de una tecnología neutra y promueven formas de apropiación crítica basadas en la justicia social y el cuidado colectivo.

En la antesala de un nuevo 8M, incluso un “inocente” juego que se torna viral puede funcionar como señal de alerta. Cuando ChatGPT me representa como varón, no está jugando: está replicando un orden social. Por eso, los feminismos tenemos un desafío central: evitar que las desigualdades históricas se prolonguen en las decisiones automatizadas.