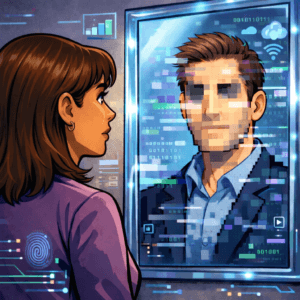

El avance de la inteligencia artificial (IA) está transformando rápidamente diversos sectores, pero también está amplificando desigualdades existentes. Un ejemplo es la presencia de sesgos, entre ellos los de género. Según un estudio del Centro Berkeley Haas para la Equidad, el Género y el Liderazgo, el 44% de los sistemas de IA analizados mostraban sesgos de género, y el 26% exhibía prejuicios tanto de género como raciales.

La infrarrepresentación de mujeres y otros grupos marginados en la industria tecnológica es una de las causas principales de este problema. Estudios como el informe «¿Dónde están las mujeres?» del Alan Turing Institute evidencian que apenas entre el 10 y el 15% de los investigadores en aprendizaje automático en empresas tecnológicas son mujeres. Este desequilibrio no solo afecta la diversidad en los equipos de desarrollo, sino también los resultados tecnológicos: sistemas que no representan ni benefician a todas las personas de manera equitativa.

La brecha de género también influye en el accionar de la IA. Los sistemas de inteligencia artificial están diseñados para tomar decisiones automatizadas en una variedad de contextos, desde contratación laboral hasta diagnósticos médicos, y estas decisiones están basadas en patrones detectados en los datos de entrenamiento. Sin embargo, si los datos contienen una representación desproporcionada o estereotipada de mujeres y minorías, los sistemas replicarán esas mismas desigualdades. Por ejemplo, sistemas de contratación que priorizan candidatos basándose en historiales laborales anteriores pueden discriminar a las mujeres si los datos muestran una baja participación femenina en ciertos sectores, perpetuando su exclusión.

Las consecuencias también son visibles en el mercado laboral. Naciones Unidas advierte que las mujeres podrían perder cinco puestos de trabajo por cada uno ganado en la transición hacia la Industria 4.0, en comparación con una pérdida de tres puestos por cada uno ganado entre los hombres. Esta disparidad subraya cómo las brechas de género en tecnología e IA afectan directamente las oportunidades económicas de las mujeres, exacerbando desigualdades en vez de reducirlas.

Resolver estos problemas requiere un enfoque integral que considere tanto la inclusión de mujeres en la industria tecnológica como la revisión crítica de los datos y algoritmos que sustentan la IA. La equidad no puede ser un agregado en el desarrollo tecnológico, sino una condición esencial para garantizar sistemas justos y representativos.

«El sesgo de sexo y género se encuentra en los datos con los que se diseña el algoritmo o con los que aprende el programa. La cuestión es cómo evitar que aparezca este sesgo y, en el caso de que haga acto de presencia, cómo eliminarlo. Las posibles soluciones se dan esencialmente desde la propia tecnología, pero más profundamente desde los cambios culturales que devienen fundamentales y que repercuten ineludiblemente en la tecnología»

Recomendaciones para evitar los sesgos en IA

- Diversificar los equipos de desarrollo: Fomentar la participación de mujeres y grupos subrepresentados en tecnología para integrar perspectivas diversas.

- Auditorías regulares: Realizar evaluaciones periódicas de los algoritmos para identificar y corregir sesgos presentes.

- Datos inclusivos: Utilizar conjuntos de datos que representen de manera equitativa a todos los grupos demográficos.

- Capacitación en ética de IA: Formar a las/los desarrolladores y tomadores de decisiones sobre los impactos sociales de la tecnología.

- Transparencia algorítmica: Diseñar sistemas con criterios claros y auditables para reducir posibles discriminaciones.

- Regulaciones claras: Impulsar marcos legales que aseguren el desarrollo y uso responsable de la IA.

Cerrar las brechas de género en la IA no solo es una cuestión de justicia, sino también de eficacia. Sistemas más diversos y justos son, en última instancia, más efectivos y sostenibles para la sociedad en su conjunto.